- Generation and Validation of Finite Element Models of Computed Tomography for Unidirectional Composites Using Supervised Learning-based Segmentation Techniques

Taeyi Kim*, Seong-Won Jin*, Yeong-Bae Kim*, Jae Hyuk Lim*†, YunHo Kim**

* Department of Mechanical Engineering, Jeonbuk National University

** Department of Aerospace Engineering, Seoul National University- 지도학습 기반 분할기법을 이용한 단층 촬영된 단방향 복합재료의 유한요소모델 생성 및 검증

김대의*· 진성원*· 김영배*· 임재혁*† · 김윤호**

This article is an open access article distributed under the terms of the Creative Commons Attribution Non-Commercial License (http://creativecommons.org/licenses/by-nc/4.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

In this study, finite element modeling of unidirectional composite materials of the computed tomography (CT) was conducted using a supervised learning-based segmentation technique. Firstly, Micro-CT scan was performed to obtain the raw volume of unidirectional composite materials, providing microstructure information. From the CT volume images, actual microstructure of the cross-section of unidirectional composite materials was extracted by the labeling process. Then, a U-net deep learning model was trained with a small number of raw images as inputs and their labeled images as outputs to generate a segmentation model. Subsequently, most of remaining images were input to the trained U-net deep learning model to segment all raw volume for identifying complex microstructure, which was used for the generation of finite element model. Finally, the fiber volume fraction of the finite element model was compared with that of experimentally measured volume to validate the appropriateness of the proposed method

본 연구에서는 지도학습 기반 분할기법을 이용하여 단층 촬영된 단방향 복합재료의 유한요소모델링을 실시하였다. 우선, 단방향 복합재료의 형상 정보를 얻기 위해 Micro-CT 스캔을 수행하여 단방향 복합재료의 순수 체적(raw volume)을 획득하였고 여기에 몇 개의 단면을 선택하여 재료의 마이크로 구조인 섬유의 형상을 라벨링하였다. 이후 재료의 단면 이미지와 라벨링한 이미지를 각각 입출력으로 U-net 모델을 훈련시켰다. 이를 사용하여 선택되지 않은 단층촬영 이미지를 섬유형상을 구분하는 분할을 수행하였고 이렇게 생성된 3차원 정보를 이용해서 유한요소모델을 생성하였다. 최종적으로 단방향 복합재료 시편과 유한요소모델의 섬유체적비를 비교하여 제안된 방법의 적절성을 확인하였다

Keywords: 단방향 복합재료(Unidirectional composite), 분할(Segmentation), 유넷(U-net), 단층 촬영(Computed Tomography), 지도학습 (Supervised Learning)

기계, 자동차, 항공우주, 건축 등 다양한 분야에서 높은 비강성/비강도, 낮은 열팽창 계수 등의 여러 이점으로 인해 복합재료가 널리 쓰이고 있다. 복합재료의 기계적 특성은 구성 성분(섬유, 기지, 필러, 계면)의 물성, 섬유 배열, 섬유의 방향 및 섬유체적비 등에 따라 달라진다. 이러한 복합재료의 기계적 특성을 측정하기 위해서는 인장, 굴곡, 충격, 평면 전단 및 압축시험을 포함한 다양한 기계시험을 통해 통계적인 방법을 활용한다. 그러나 이러한 실험적인 방법은 시간과 노동이 많이 소요되어 비효율적이다. 따라서 복합재료의 형상을 고려한 수치해석 방법으로 기계적 특성을 효과적으로 획득하는 연구가 필요하다.

이러한 노력을 위해서는 우선 복합재료의 미시구조가 잘 표현된 유한요소모델의 생성이 필요하다. 미시구조 연구에는 주로 정사각형 또는 육각형 형태의 이상적인 단위 셀과 같은 유한요소모델을 사용하며 이를 대표체적요소(representative volume element, RVE)이라고 한다. 그러나 이러한 연구는 복합재료의 섬유 배열이 규칙적이고 주기적인 패턴을 따른다는 가정을 사용하기 때문에 섬유가 교차하거나 무작위로 분포하는 경우에는 적절하지 않다[1]. 따라서 균일하지 않은 복합재료의 미세 구조 특성을 고려한 모델링 연구가 필요하다.

Chen 등[1]은 몬테카를로 알고리즘을 사용하여 다양한 균일성을 가진 다중 섬유 RVE를 생성하고 인터페이스의 응력분포를 확인하였다. Wongsto 등[2]은 무작위 배열의 단위 셀을 생성하고 다양한 경계조건에 대한 연구를 수행하였다. Jin 등[3]은 무작위 배열의 단위 셀에서 인터페이스 응력 및 열 잔류 응력 분포를 연구했다. 또한, Woo 등[4]은 평직복합재료(plain weave composite)를 이상적인 대칭형태의 이상적인 단위 셀 형태로 유한요소모델을 제작하였다. 제작한 유한요소 모델을 통해 파손해석을 수행하였으며, 시험 값과 유사한 결과값이 도출되는 것을 확인하였다. 그러나 기존에 수행된 연구에서의 모델은 섬유의 형상을 원형으로 가정하는 등 실제 형상과 상이한 부분이 있으므로 해석을 통해 도출된 값이 실제 시험 결과 값과 다를 수 있다.

최근에는 이러한 한계로 인해 실제 복합재료의 형상을 활용한 연구가 많이 수행되고 있다. 대표적인 연구로는 단방향 복합재료의 경우에는 비원형섬유의 특징과 섬유 배치를 그대로 살려서 RVE를 생성하거나 촬영된 단면 이미지를 그대로 모델링하는 방법이 널리 사용되고 있다. 또한 미소시편을 마이크로 수준의 미시구조를 파악할 수 있는 3차원 단층촬영장비(Micro-computed tomography, μCT)을 통해 3차원 유한요소모델을 생성하는 연구가 있다[5-7].

특히 인장시험기 등과 결합을 통해 하중증가에 따른 미시구조의 실시간 섬유 파손, 층간 분리, 균열 등의 복합재료 내부의 미시구조 변화를 관찰하거나[8] 섬유 강화 콘크리트의 탄성 특성, 복합재료의 손상, 콘크리트의 복잡한 비선형 파괴에 대한 시험 및 해석의 상관관계를 파악하는 하는 연구도 보고되었다[9].

Morita 등[10]은 단방향 탄소섬유 강화 플라스틱 복합재료의 횡단면을 μCT 촬영을 통해 수치 모델을 생성하고 섬유의 형상에 따른 성능을 비교분석 하였다. 또한, Kim 등[7]은 2D micro CT 이미지에서 단방향 복합재료의 섬유와 기지를 분리하고 노이즈를 제거하여 2D CAD 표면(surface)을 생성하였다. 생성한 surface의 연결을 통해 3D CAD 모델을 생성하였으며, 이를 통해 3D 유한요소모델을 생성하고 구조해석을 통해 검증하였다.

그러나 기존에 수행된 연구에서는 일정 간격으로 6개의 이미지만을 사용하여 유한요소모델을 생성하기 때문에 실제 존재하는 국소적인 기공(void)의 형상정보를 완벽하게 반영하지 못한다. 따라서 본 연구에서는 모든 μCT 이미지의 정보를 최대한 활용하기 위해 Fig. 1에 제시된 절차도와 같이 단방향 복합재료의 μCT 이미지와 딥러닝 기법인 유넷(U-net)을 결합하여 분할 작업을 수행하고 이를 토대로 유한요소모델을 생성하고 검증을 수행하려고 한다[11].

|

Fig. 1 Flowchart of 3D FE model generation based on μCT image |

2.1 μCT 이미지 촬영

μCT 스캔을 위한 시편은 적층 시퀀스 [0]1를 갖는 M55/M18 단방향(unidirectional, UD) 복합재료를 이용해 제작되었다. 온도 180oC, 압력 4 bar의 조건에서 2시간동안 경화된 1-ply 단방향 복합재료를 커터로 잘라 2 mm × 0.3 mm × 0.1 mm의 크기를 갖는 시편을 획득하였다. 각 시편은 핀을 이용해 광학스테이지에 장착하였고, Table 1의 규격을 가지는 CT 스캐너(ZEISS Xradia Ultra 800, KIST Jeonbuk Institute)에 수직으로 장착하여 μCT 이미지를 촬영하였으며, 장비의 형상은 Fig. 2와 같다. μCT 스캐닝을 수행하여 Fig. 3에 나타낸 504 × 512 × 506(X × Y × Z) 픽셀의 순수 체적을 획득하였다[7]. 여기서 순수 체적을 XY 방향으로 분할하여 506개 단면 이미지를 생성하였다. 생성된 이미지의 픽셀 크기는 0.126 μm이며, 각 이미지는 504 × 512 픽셀의 크기를 가진다. 따라서 생성한 이미지의 실제 단방향 복합재료의 크기는 약 64 μm × 64 μm × 64 μm이다.

2.2 μCT 이미지 라벨링

U-net 모델을 훈련시켜 주어진 CT 이미지를 분할을 하기 위해서는 CT 스캔을 통해 얻어진 순수 이미지와 이진 마스크(binary mask) 이미지를 출력으로 지도학습을 시켜야 한다[11].

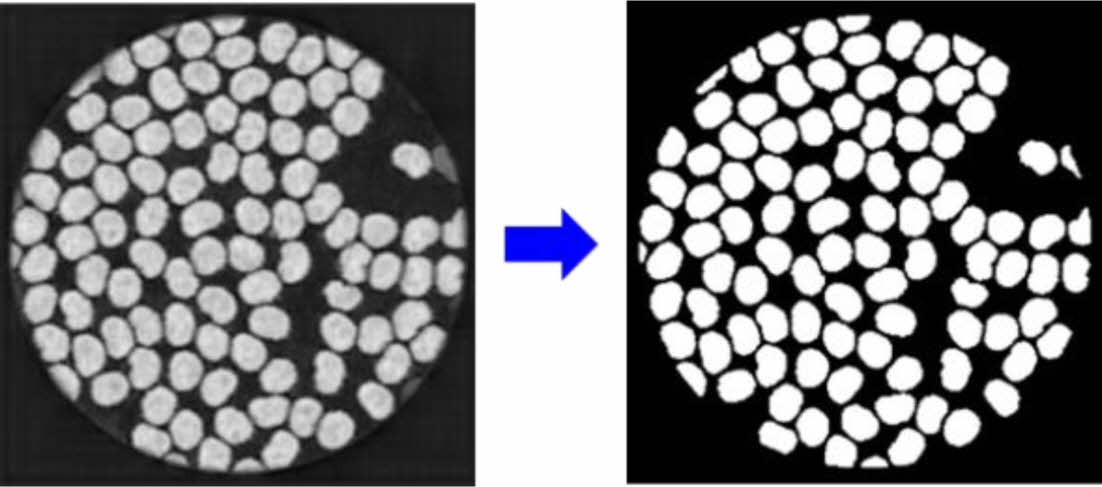

이를 위해서는 원본 이미지의 라벨링이 요구된다. CT로 촬영된 506개 이미지 중에서 같은 간격으로 25개의 이미지를 선택하여 라벨링을 수행하였다. 본 연구에서는 MATLAB 2023[12]에서 이미지를 이진으로 분류해주는 im2bw 함수를 사용하였다. 라벨링 수행 이전에 라벨링 임계 값을 찾기 위한 이미지 픽셀 값 분포를 확인하기 위해Fig. 4와 같이 순수 이미지의 히스토그램을 나타내었다. x축은 픽셀 값, y축은 해당 픽셀 값의 개수를 나타낸다. Fig. 5(a)의 순수 이미지는 픽셀 값 135를 기준으로 정규분포를 이루므로 135이상일 경우 255, 135미만일 경우 0으로 분류하였다. 이 과정에서 라벨링이 적절하게 되지 않거나 섬유끼리 겹치는 부분은 수동으로 지워주는 등의 적절한 후처리를 통해 Fig. 5(b)의 라벨링 이미지를 획득하였다.

2.3 U-net을 이용한 이미지 분할

이미지 분할은 Fig. 6(a)의 의미적 분할(sementic segmentation) 분할과 Fig. 6(b)의 인스턴스 분할(instance segmentation) 두 가지가 사용된다. 의미적 분할은 이미지에 있는 모든 픽셀을 미리 지정된 클래스로 분류하는 방법이다. 따라서, 이미지의 각 픽셀을 세밀한 수준에서 분류하여 각 픽셀 간의 차이를 파악하는 특징이 있다. 인스턴스 분할은 이미지에서 개별 객체의 윤곽의 식별이 가능하다. 동일한 클래스에 속하는 여러 객체가 존재하는 경우에 객체의 구별을 수행할 수 있다. 본 연구에서는 단방향 복합재료를 섬유와 기지 두가지로 분할하기 때문에 의미적 분할 방법을 사용하였다.

본 연구에서는 의미적 분할을 수행하기 위해 딥러닝 기법인 U-net을 사용하였다[11]. U-net은 기존 합성곱오토엔코더(convolution autoencoder, CAE)와 유사하게 “U” 모양의 네트워크 구조를 가지며, 인코더 부분인 수축패스(contracting path)와 디코더 부분인 확장패스(expansive path) 두 부분으로 나뉜다. 수축패스는 일반적인 합성곱신경망과 같으며 다운샘플링을 위한 스트라이드(stride), 최대풀링(maxpoolng)과 비선형성 표현을 위한 렐루(rectified linear unit, ReLU) 연산 그리고 3 × 3 커널을 이용한 합성곱연산을 수행한다. 확장패스는 합성곱연산을 통해 업샘플링을 수행한다.

이러한 CAE와 유사한 구조는 특징추출을 위해 차원을 축소한 후 복원을 하기 때문에 네트워크를 통할 때 손실이 존재하며 이를 보상하기 위해 Resnet[13]에서 처음 적용된 스킵 커넥션(Skip-connection) 구조를 넣어서 원본 이미지로부터 의미적 분할 성능 및 위치 정확도를 대폭 향상시킨 것으로 알려져 있다.

단방향 복합재료의 분할을 수행하기 위해 본 연구에서는 Fig. 7의 U-net 모델을 구현하였다. 각 레이어의 필터는 32, 64, 128, 256, 512로 구성하였다. Fig. 5(a)에 나타낸 512 × 506 크기의 원본 이미지 25개를 입력으로 하고 Fig. 5(b)에 나타낸 이진 분할된 이미지 25개를 출력으로 하여 학습을 수행하였다. 훈련과정에서 사용된 하이퍼 파라미터는 에폭(epoch) 50, 3 × 3 커널, 2 × 2 maxpooling, 활성화 함수는 ReLU, optimizer는 Adam, 그리고 학습률은 0.001을 사용하였다.

U-net 훈련을 통해 학습한 모델을 통해 학습에 참여하지 않은 481장의 분할을 수행하였다. 분할에는 수초가 소요되었으며 적은 데이터를 사용하여 U-net을 훈련시켰음에도 불구하고 Fig. 8과 같이 각 단면에 존재하는 섬유의 형상을 높은 정확도로 검출하였다. 이외에도, Fig. 8과 같이 훈련 데이터를 생성함에 있어 고려하지 않았던 기지 내부의 빈 공간에 대해서도 검출이 이루어졌다.

분할을 통해 생성된 이미지는 완벽한 이진 이미지가 아니므로 따라서 Fig. 9에 나타낸 것과 같이 생성된 이미지에 Fig. 4의 임계 값인 135를 기준으로 이미지 픽셀 값을 0 또는 255로 이진화 하여 이진 이미지를 획득하였다.

이렇게 획득한 이진 이미지의 품질을 확인한 결과, 대부분의 이진 이미지에서 섬유의 중첩없이 분리가 잘 되었지만, Fig. 10과 같이 매우 근접한 섬유의 경우에는 섬유가 결합되는 경우가 발생하였다. 그 이유는 CT 이미지의 국부적인 해상도와 관련있다고 판단된다. 이러한섬유의 중첩을 해결하기위해 watershed 알고리즘[14] 등의 방법을 사용하여 자동적인 섬유의 분리가 가능하나 본 연구에서는 섬유의 중첩을 수동으로 제거하였다.

|

Fig. 2 ZEISS Xradia Ultra 800 |

|

Fig. 3 μCT images of unidirectional composite |

|

Fig. 4 Histogram of raw image pixel for labeling threshold determination |

|

Fig. 5 Process of labeling μCT images: (a) Raw images (input) and (b) Labeled images (output) |

|

Fig. 6 Types of segmentation techniques: (a) Sementic segmentation and (b) Instance segmentation |

|

Fig. 7 U-net architecture for UD composite image segmentation |

|

Fig. 8 Detected void in segmented images |

|

Fig. 9 Generation of binary images through post-processing of segmented images |

|

Fig. 10 Merged fibers in segmented images |

3.1 분할 이미지를 이용한 유한요소모델 생성 및 검증

분할된 이미지를 적층하여 Fig. 11의 512 × 504 × 506 (X × Y × Z) 픽셀 크기의 복셀 체적을 생성하였다. 그러나 μCT 원본 이미지가 실린더의 형태를 가지게 촬영되었기 때문에 복합재료 부분이 아닌 외부의 픽셀까지도 기지로 생성되어 유한요소모델의 적절한 구현이 어렵다. 따라서 분할된 이미지를 사각형 형태의 트리밍을 수행하였다.

트리밍된 330 × 368 × 506 픽셀의 복셀 체적을 가지고 오픈소스 프로그램인 S2M[15]을 사용해 Fig. 12의 유한요소모델을 생성하였다. 유한요소모델은 4절점 4면체요소(C3D4) 기반으로 생성되었으며, 요소와 절점의 개수는 각각 2,281,398개, 420,842개이다. 최종적으로 생성된 유한요소모델의 크기는 약 42 μm × 46 μm × 64 μm이다.

생성된 유한요소모델의 검증을 위해 실제 단방향 복합재료 시편과 유한요소모델의 섬유체적비를 비교하였다. 단방향 복합재료 시편의 섬유체적비는 현미경을 이용한 이미지 프로세싱 또는 황산에 기지재료를 녹이거나(ASTM standard D 3171-15[16]) 고온으로 태워(ASTM D3529-16[17]) 남은 질량을 측정하는 방법이 널리 사용된다[18]. 고온 연소법(high-temperature ignition method)으로 획득한 단방향 복합재료 시편의 섬유체적비는 60%[7]이며, 유한요소모델의 섬유와 기지의 체적을 사용해 계산한 결과 섬유체적비는 56.7%로, 3.3% 차이의 유사한 값이 도출되었다. 따라서 본 연구에서 제안한 방법을 통해 생성한 유한요소모델이 적절함을 확인하였다. 또한, 기존에 섬유체적비 획득 방법들은 기본적으로 시편을 파손해야 한다는 공통적인 단점이 있는 반면, 본 연구에서는 시편의 파손없이도 섬유체적비의 도출이 가능함을 확인하였다.

섬유체적비의 유사함을 확인하였지만, CT 이미지와 생성된 유한요소 모델에서 섬유의 형상이 일치하는지에 대한 의문점이 있을 수 있다. 따라서 섬유 단면의 비교를 위해 Fig. 13과 같이 단방향 복합재료 이미지의 일부를 가지고 비교하였다. Fig. 13(a)의 CT 스캔 이미지, Fig. 13(b)의 분할 이미지, Fig. 13(c)의 유한요소모델의 단면 형상의 비교를 통해 약간의 오차는 있지만, 섬유 단면의 형상이 유사함을 확인하였다. 따라서 시편 외부의 섬유 형상을 관찰하여 비교하는 주사전자현미경(scanning electron microscope, SEM) 촬영과 같은 기법과 비교했을 때, 본 연구에서 제안한 방법은 3차원으로 형상을 구현하여 내부의 형상까지도 파악할 수 있는 장점이 있다.

섬유체적비 비교 및 섬유 단면 형상 비교를 통해 단방향 복합재료의 시편과 유한요소모델의 대략적인 형상의 유사함은 확인하였지만, 파손, 인장 등의 해석을 수행하기에는 유한요소모델의 세부적인 품질의 개선이 필요하다. 우선, Fig. 14와 같이 유한요소모델에서 섬유 단발이 중첩하여 생성되는 문제가 발생하였다. 분할 과정에서는 중첩된 형상이 발견되지 않았던 부분이지만, 프로그램을 통해 유한요소모델을 생성하는 과정에서 중첩이 발생하였다. 이는 정육면체 형상의 복셀체적을 유한요소 생성 프로그램을 통해 부드러운 곡선 형태로 바꾸어 주는 과정에서 인접한 부분을 매끄럽게 표현하기 위해 발생하는 현상이다. 따라서 복셀 체적의 적절한 크기 조정이나, 유한요소모델 생성 후에 섬유의 중첩 부분을 분리하는 작업이 필요할 것으로 판단된다. 유한요소모델의 절점의 개수가 420,842 수준으로 매우 많은 것 또한 문제이므로 유한요소모델의 자유도 적절히 줄여 해석 시간의 감소를 유도할 필요가 있다.

|

Fig. 11 UD composite voxel volume |

|

Fig. 12 UD composite FE model |

|

Fig. 13 Comparison of the cross-sectional shapes of UD fibers: (a) μCT image (b) Segmented image (c) Finite element model |

|

Fig. 14 Merged FE mesh in UD composite FE model |

본 연구에서는 지도학습기반 딥러닝 기법을 이용한 분할을 통해 단방향 복합재료의 유한요소모델링을 수행하였다. CT 스캔을 통해 얻은 단방향의 원본 이미지의 라벨링을 수행하고, 원본 이미지와 라벨링을 통해 얻은 이진 이미지를 사용해 U-net 모델을 학습시켜 분할을 수행하였다. 분할된 이미지의 후처리를 수행하고 이미지의 적층을 통해 복셀 체적을 생성하고 유한요소모델을 생성하였다. 결론적으로 생성된 유한요소모델과 실제 단방향 복합재료의 섬유체적비가 유사하였으므로 제안된 비파괴 방식의 섬유체적비 획득 방법이 적절함을 확인하였다.

그러나 유한요소모델 생성에 4절점 4면체 요소를 이용하였기 때문에 단방향 복합재료의 기계적 특성을 파악하기 위한 정확한 파손해석을 수행하기 어렵다. 4절점 4면체 요소의 경우 8절점 6면체 요소(C3D8)와 비교하였을 때 해의 수렴도가 상대적으로 낮기 때문이다[19]. 추후에는 이러한 고려사항을 반영하기 위해 8절점 6면체 요소로 구성된 유한요소모델을 생성하는 연구를 수행할 계획이다.

그리고 생성된 단방향 복합재료의 유한요소모델의 경우 이미지 분할 단계에서 일부 섬유 간의 중첩이 발생하는 등의 문제가 생겼는데. 이는 구조해석 결과 값에 영향을 줄 수 있기 때문에 watershed 알고리즘 등의 방법을 사용하여 섬유의 분리를 수행할 예정이며, 실제 시편과 최대한 유사한 모델을 생성하기 위해 기공을 고려한 모델링 방법도 강구하고 있다. 추후, 검증된 방법을 통해 조금 더 복잡한 평직, 능직(twill weave) 복합재료 등의 미시구조 모델링도 수행할 예정이다.

본 연구는 2022년도 정부(방위사업청)의 재원으로 국방기술진흥연구소의 지원(KRIT-CT-22-040, 이종 위성군 우주 감시정찰 기술 특화연구센터)과 2022년도 정부(산업통상자원부)의 재원으로 한국 에너지기술평가원의 지원(20224000000220, 전북지역에너지클러스터 인재양성사업)을 받아 수행된 연구임.

- 1. Huang, Y., Jin, K.K., and Ha, S.K., “Effects of Fiber Arrangement on Mechanical Behavior of Unidirectional Composites,” Journal of Composite Materials, Vol. 42, No. 18, 2008, pp. 1851-1871.

-

- 2. Wongsto, A., and Li, S., “Micromechanical FE Analysis of UD Fibre-reinforced Composites with Fibres Distributed at Random over the Transverse Cross-section,” Composites Part A: Applied Science and Manufacturing, Vol. 36, No. 9, 2005, pp. 1246-1266.

-

- 3. Jin, K.K., Oh, J.H., and Ha, S.K., “Effect of Fiber Arrangement on Residual Thermal Stress Distributions in a Unidirectional Composite,” Journal of Composite Materials, Vol. 41, No. 5, 2007, pp. 591-611.

-

- 4. Woo, K., Lim, J.H., and Han, C., “Effect of Defects on Progressive Failure Behavior of Plain Weave Textile Composites,” Materials, Vol. 14, No. 16, 2021, pp. 4363.

-

- 5. Garcea, S., Wang, Y., and Withers, P., “X-ray Computed Tomography of Polymer Composites,” Composites Science and Technology, Vol. 156, 2018, pp. 305-319.

-

- 6. Czabaj, M.W., Riccio, M.L., and Whitacre, W.W., “Numerical Reconstruction of Graphite/epoxy Composite Microstructure Based on Sub-micron Resolution X-ray Computed Tomography,” Composites Science and Technology, Vol. 105, 2014, pp. 174-182.

-

- 7. Kim, D.-W., Lim, J.H., Kim, S.-W., and Kim, Y., “Micro-computed Tomography-aided Modeling for Misaligned and Noncircular Fibers of Unidirectional Composites and Validation Under a Transverse Tensile Loading,” Composites Science and Technology, Vol. 212, 2021, pp. 108879.

-

- 8. Jeong, G., Lim, J.H., Choi, C., and Kim, S.-W., “A Virtual Experimental Approach to Evaluate Transverse Damage Behavior of a Unidirectional Composite Considering Noncircular Fiber Cross-sections,” Composite Structures, Vol. 228, 2019, pp. 111369.

-

- 9. Chung, S.-Y., Kim, J.-S., Stephan, D., and Han, T.-S., “Overview of the Use of Micro-computed Tomography (micro-CT) to Investigate the Relation between the Material Characteristics and Properties of Cement-based Materials,” Construction and Building Materials, Vol. 229, 2019, pp. 116843.

-

- 10. Morita, S., Ueda, M., Takahashi, T., Kajiwara, K., Yoshimura, A., and Sugiura, N., “Performance Assessment for Fiber Tracking of Unidirectional Carbon Fiber Reinforced Plastic by Digital Image Correlation of X-ray Computed-tomography,” Advanced Composite Materials, Vol. 32, No. 1, 2023, pp. 35-47.

-

- 11. Ronneberger, O., Fischer, P., and Brox, T., “U-net: Convolutional Networks for Biomedical Image Segmentation,” Proceeding of the In Medical Image Computing and Computer-Assisted Intervention–MICCAI 2015: 18th International Conference, Munich, Germany, Oct. 2015, pp. 234-241.

-

- 12. MathWorks, 2023, MATLAB R2023a Documentation. Retrieved from “https://www.mathworks.com/help/matlab”

- 13. Targ, S., Almeida, D., and Lyman, K., “Resnet in Resnet: Generalizing Residual Architectures,” arXiv preprint arXiv:1603.08029, 2016.

-

- 14. Kornilov, A.S., and Safonov, I.V., “An Overview of Watershed Algorithm Implementations in Open Source Libraries,” Journal of Imaging, Vol. 4, No. 10, 2018, pp. 123.

-

- 15. Sinchuk, Y., Shishkina, O., Gueguen, M., Signor, L., Nadot-Martin, C., Trumel, H., and W.V. Paepegem, “X-ray CT based Multi-layer Unit Cell Modeling of Carbon Fiber-reinforced Textile Composites: Segmentation, Meshing and Elastic Property Homogenization,” Composite Structures, Vol. 298, 2022, pp. 116003.

-

- 16. ASTM, Standard Test Methods for Constituent Content of Composite Materials, D3171-15.

-

- 17. ASTM, Standard Test Methods for Constituent Content of Composite Materials, D3529-16.

-

- 18. Kim, Y., Kumar, S., Choi, C., Kim, C.-G., Kim, S.-W., and Lim, J.H., “Method for Determining Fiber Volume Fraction in Carbon/epoxy Composites Considering Oxidation of Carbon Fiber,” Composites Research, Vol. 28, No. 5, 2015, pp. 311-315.

-

- 19. Fagiano, C., Genet, M., Baranger, E., and Ladevèze, P., “Computational Geometrical and Mechanical Modeling of Woven Ceramic Composites at the Mesoscale,” Composite Structures, Vol. 112, 2014, pp. 146-156.

-

This Article

This Article

-

2023; 36(6): 395-401

Published on Dec 31, 2023

- 10.7234/composres.2023.36.6.395

- Received on Nov 28, 2023

- Revised on Dec 7, 2023

- Accepted on Dec 21, 2023

Services

Services

Shared

Correspondence to

Correspondence to

- Jae Hyuk Lim

-

Department of Mechanical Engineering, Jeonbuk National University

- E-mail: jaehyuklim@jbnu.ac.kr

Copyright ⓒ The Korean Society for Composite Materials. All rights reserved.

Copyright ⓒ The Korean Society for Composite Materials. All rights reserved.